| Tools |

| ComfyUI Luma Dream Machine Runway Suno Adobe Photoshop Adobe Premiere |

| Techniques |

| txt2img img2vid |

Generative AI、Flux.1 dev、Luma Dream Machine と Runway を使用して 60 秒のビデオを作成しました。音楽はSunoのAI生成曲です。ビジュアル系バンドのミュージック ビデオ スタイルにチャレンジしてみました。

何気にSUNOにはまりつつある…

このAI動画については楽曲を先行して作成しました。SUNO見てたらヴィジュアル系を歌わせられるようだったので、興味がわいて試したのが苦労の始まりだったw

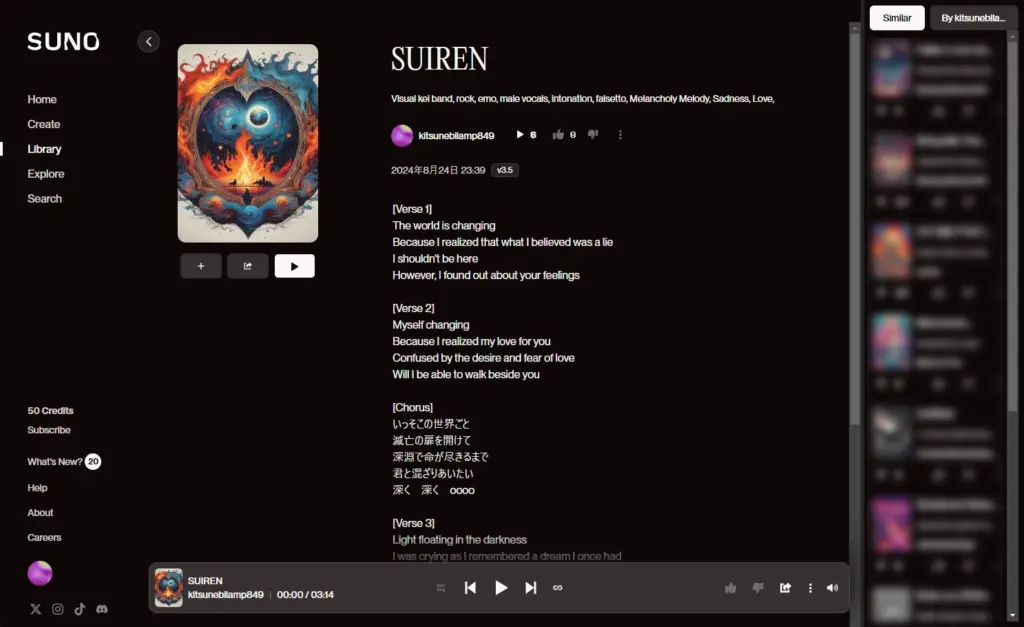

SUNOに設定した音楽のスタイル

Visual kei band, rock, emo, male vocals, intonation, falsetto, Melancholy Melody, Sadness, Love,

いつもはAI任せで楽曲生成させてたんですが、歌に日本語も使わせたかったので今回は歌詞も考えました。久しぶりに中二病脳にスイッチ切り替えてチャレンジ。で、用意したリリックがこんな感じ。

あ、タイトルの「SUIREN」は「睡蓮」で、なんか「滅亡」って花言葉があるってネットでチラッとみたのでチョイスした次第です。

[Verse 1]

The world is changing

Because I realized that what I believed was a lie

I shouldn't be here

However, I found out about your feelings

[Verse 2]

Myself changing

Because I realized my love for you

Confused by the desire and fear of love

Will I be able to walk beside you

[Chorus]

いっそこの世界ごと

滅亡の扉を開けて

深淵で命が尽きるまで

君と混ざりあいたい

深く 深く oooo

[Verse 3]

Light floating in the darkness

I was crying as I remembered a dream I once had

I hear a gentle voice in my ear

Did you see hope beyond your despair

[Bridge]

With my eyes closed, I feel a faint presence

It's supposed to be a world just me and you

Why do I sometimes feel murderous intent

[Chorus]

いっそこの世界ごと

滅亡の扉を開けて

深淵で命が尽きるまで

君と混ざりあいたい

深く 深く ooooフルバージョンは3分14秒もあって動画にするのキツそうだったので1分までの部分を使いました。(フルVer聴いてみたい方は下記のリンクより)

SUNOで生成された楽曲フルVerはこちら

それからSUNO使ってる人は気付いてると思いますが、SUNOで生成した曲のボーカルってちょっともたついてるっていうか、モワ~っていう感じの発声に感じるんですよね。AI生成であることを分かりやすくするためにあえてそういう品質にしてるのか定かではありませんが。

なので、私は動画に音楽充てる際は、一度、ピッチ・キー変更の処理を行いました。今回はそれでビジュアル系感が少し増しましたw

ピッチ変換が出来る無料オンラインツール My Edit

https://myedit.online/jp/audio-editor/pitch-changer

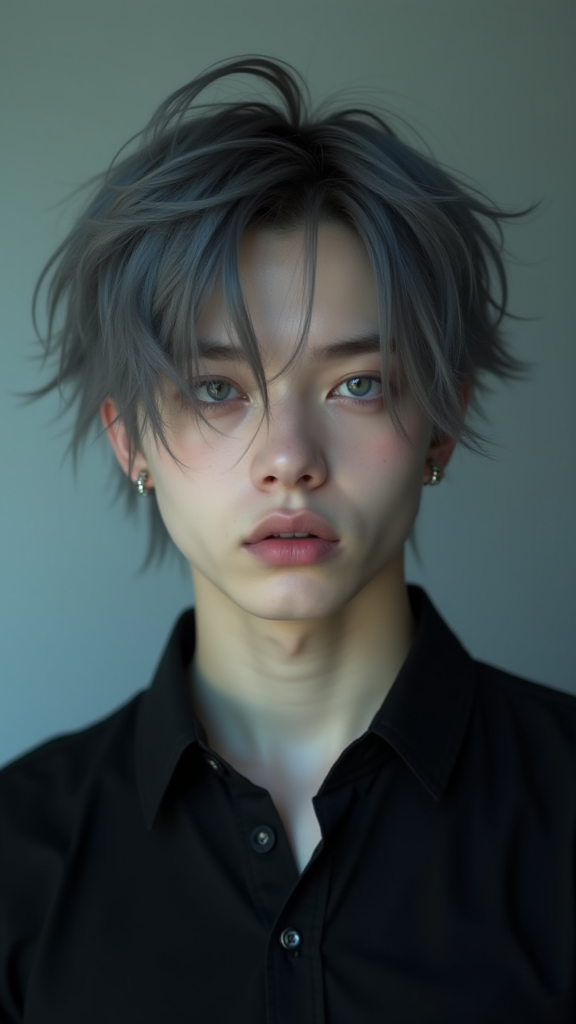

動画用のAI生成画像

実は歌詞考えたり、動画生成、編集するより、今回はこれが一番きつかったです。というのも、Pony系で顔の固定や、ネガティブプロンプトで微調整や制限かけれるモデルを使うべきだったのですが、Flux.1 devでつくりはじめちゃって…

もちろんFlux.1の生成クオリティ自体は絶好調なのですが制御が効かなくてですね。狙い通りのもの生成しようとすると、ひたすらガチャやる感じです。

顔固定とかならComfy UIでControlNet使って生成処理段階である程度絞り込めるみたいなブログも見たんですが、VRAM結構使うみたいなこと書いてあって私の環境ではちょっと無理そうでした。

顔以外の調整は再描きだしするよりは、Photoshopでの補正の方が効率的ですね。

動きの必要な動画生成で気付いたこと(Luma)

Lumaでの動画生成で、「ああそういうことなのかな?」と思ったことがあったので試してみました。まずはお団子頭のベース君の素材動画を見てください。

最初のはComfy UIで生成した元となる画像。動画はそれをLumaで動画生成したものです。元画像のベースヘッドやペグが見切れているため、動画生成時に崩れてしまっています。

仕上げてしまった動画についてはこの動画で崩れているところをシーケンス外に見切れるようコントロールしました。そのためスケールも拡大しなくてはならなくなってしまい、不自然なズームやギリギリまでヘッドが入らないようにする調整が必要でした。

ポジティブに言い訳すれば、ダイナミックで動きのあるカメラワーク…と言いようもありますが。

で、ずっと次の日もどうすればよりベターだったんだろうって考えてたんですよ。

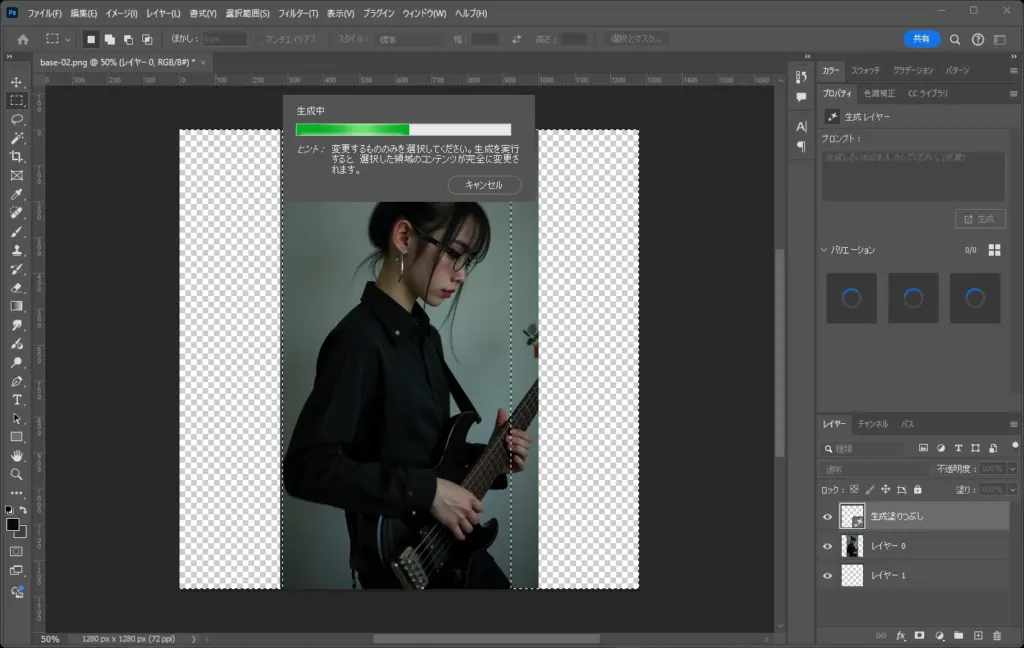

生成に再現したい情報ははじめからAIに伝える

どういうことかと言うと、一旦メディアのサイズを頭から切り離しました。

素材用の画像を 720×1280 で生成してたのですが、Photoshopで1280×1280にします。

Photoshopで解像度を長辺の1280にあわせ、1280×1280にします。

生成塗りつぶしを行います。1度でうまくいかない場合は何度か繰り返したり、一度に全部塗りつぶさないなど試すといいかもです。

それでもヘッドのカタチがいびつだったり、ペグの数がおかしかったりすることはあるのでそのへんはペンやブラシツールなどでレタッチします。

遠近感の表現でぼかして見えるところも、雑でもいいので、線や塗りで、背景色に取り込まれてしまわないように処理します。

この画像の場合は、ベースのヘッドとペグの接点が薄かったので、ブラシでしっかりヘッドにつながって見えるよう処理しました。

最初に生成した動画と同じEnhance promptで動画生成してみます。

Play a guitar riff at a fast BPM. The finger holding the fret moves slightly on the fret. The other hand wiggles up and down around the pickup. The face remains invisible. The camera hardly moves.ベースがこんにゃくのようになってしまったのはご愛敬ですが、あとは Premiere pro で使いたいとこだけスケール調整しながらシーケンスに収めれば、見切れた画像から生成した動画よりも、極端なヘッドの崩れはおこりにくいので扱いやすいですね。

あ….。5弦ベースじゃんか。。。